to cheia de ansiedade se eu tivesse o controle do adam sandler em click eu apertava ahr forsdase

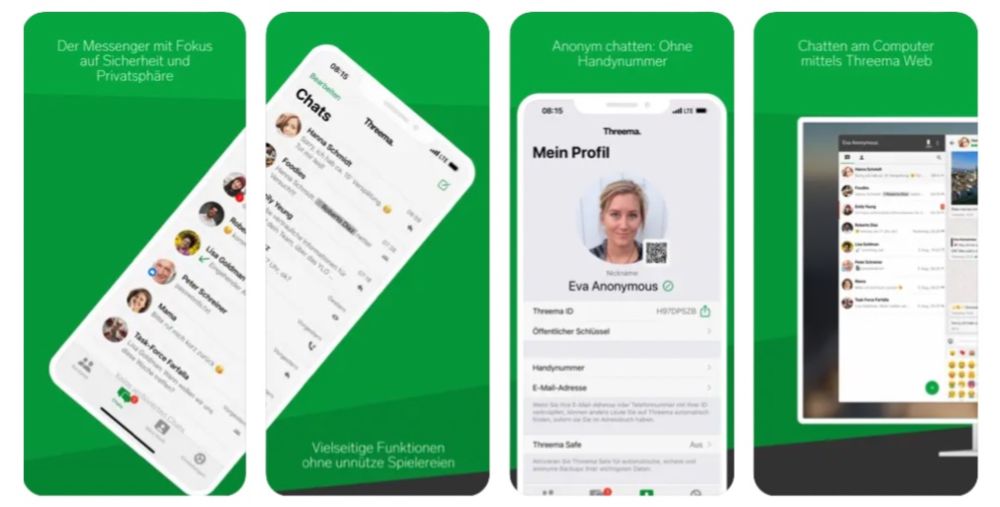

Threema gehört aus Datenschutzsicht immer noch zu den interessantesten Messengern und bekommt wieder einmal ein größeres Update spendiert. Mehr erfahrt Ihr hier >> wp.me/p7za8I-AHR

Threema gehört aus Datenschutzsicht immer noch zu den interessantesten Messengern und bekommt wieder einmal ein größeres Update spendiert. Mehr erfahrt Ihr hier

Wir spielen am 26.10.24, 20h im #Landgasthof#Weihs#Kreuzberg#Ahr#Flüsterkonzert Eintritt ist frei, Hut steht bereit. Wir freuen uns auf Euch!

Interssant med Lysglimt. Han ble mediapersonlighet kun pga NRKs behov for falsk balanse. Hurra, vi ahr funnet én som sier noe pent om Trump!

acho q ahr é por outro motivo

tira un 8d6 para mi a ver cuanta sanidad pierdes ahr

dos times que assisti jogar até ahr, estou gostando mt dos Krakens, Bruins e jets... tô vendo Leafs e penguins agr e gostando mais dos Leafs, vamos ver quanto tempo até eu decidir em um

Die Ahrtalbahn wird wieder aufgebaut. Hier ca. 1000 m Ahr aufwärts von Walporzheim. Freut mich. Nur sehe ich keine Lernkurve, die Bahn ist doch beim nächsten extrem wieder kaputt.